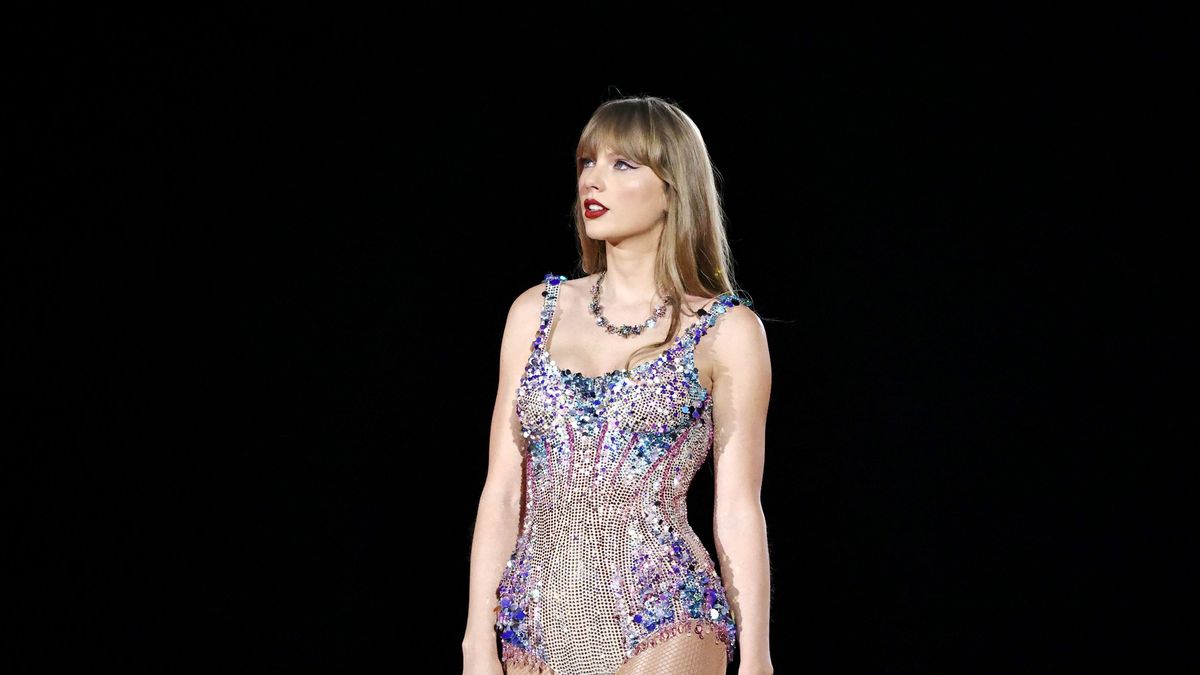

Nei giorni scorsi, alcune immagini sessualmente esplicite di Taylor Swift, alcune anche di tipo pornografico, sono diventate virali su X (il social conosciuto come Twitter) dove hanno ottenuto milioni di views (una in particolare è arrivata a 47 milioni prima della sua rimozione). Peccato che siano finte e che siano state create con l'intelligenza artificiale: la loro diffusione sui social ha mostrato quanto il deepfake porn, ovvero la tecnica per cui si usa l'AI per manipolare foto reali con immagini create artificialmente, sia una piaga non solo social ma anche e soprattutto culturale.

Partiamo dall'inizio: come ha riportato il sito 404 Media, dopo la loro creazione con un tool di Microsoft per l'AI, queste immagini sarebbero state inizialmente condivise su un gruppo Telegram nascosto e poi avrebbero travalicato i confini più profondi del web, dove la pornografia non consensuale e il deepfake porn prolifera, arrivando sulla homepage di X (ex Twitter) social attualmente guidato da Elon Musk. Le foto sono diventate virali in pochissimo tempo, senza controllo e senza blocchi: gli Swifties, i fan più affezionati e agguerriti di Taylor Swift, hanno individuato quasi subito la provenienza illegale di quelle immagini e hanno iniziato un processo di segnalazione di massa dei contenuti bombardando X con l'hashtag #ProtectTaylorSwift. Attirata l'attenzione dei vertici aziendali, le foto sono state rimosse anche se ormai in quasi 50 milioni di persone le avevano viste (e in certi casi re-postate, salvate e inoltrate ad altri utenti). Da X hanno fatto sapere che i loro team sono impegnati a rimuovere attivamente «tutte le immagini identificate: si stanno adottando le azioni appropriate contro gli account responsabili della loro pubblicazione, monitorando attentamente la situazione per garantire che eventuali ulteriori violazioni vengano immediatamente affrontate e che il contenuto venga rimosso». Swift, dal canto suo, si è detta «furiosa» per quanto accaduto, pronta ad avviare una procedura legale non solo per difendere la sua posizione e trovare i responsabili dell'abuso, ma anche per spingere alla creazione di leggi e norme che proteggano altre donne in futuro.

Esistono centinaia di siti che sfruttano l'intelligenza artificiale per creare video e immagini sessualmente esplicite di celebrità, ovviamente senza il loro consenso. Certo, le piattaforme social hanno attivato, negli anni, delle protezioni e dei blocchi per impedire che questi contenuti arrivino sui feed, ma il caso di Swift ha dimostrato senza ombra di dubbio che esistono delle falle, soprattutto su X, che, dopo l'arrivo di Musk, ha perso decine di risorse impegnate con la moderazione dei milioni di post e foto pubblicate sulla piattaforma ogni giorno.

I contenuti e le immagini manipolate o create grazie all'AI sono diventati, nell'ultimo biennio, sempre più credibili: mentre la tecnologia avanza e viene usata anche per scopi virtuosi, rimane pressante la necessità di creare dei riferimenti legislativi per evitare il dilagare di immagini sessuale esplicite e intime non consensuali e false come è successo a Taylor Swift. Che, purtroppo, non è l'unica celebrità ad essere stata vittima di questo abuso: nell'elenco c'è persino Michelle Obama, protagonista di un deepfake porn poi diventato virale su Reddit.

Il fatto che il deepfake porn prenda di mira quasi sempre le donne è sintomo di un fenomeno dilagante e sessista che sfrutta i corpi e i volti senza consenso per alimentare un mercato pornografico spesso tarato su desideri e perversioni maschili. Si tratta di una questione giuridica, dato che, soprattutto in America, si sta chiedendo a gran voce che questi crimini vengano inseriti nella lista di quelli federali; poi social, visto che i contenuti sono creati grazie a tecnologie avanguardistiche; infine soprattutto culturale. Taylor Swift è l'ultima vittima illustre di queste dinamiche, ma chiunque abbia mai pubblicato una sua foto sul web potrebbe, purtroppo, finire al suo posto: servono regole chiare non solo per tutelarsi, ma anche per evitare che il fenomeno dilaghi.